Ler Resumo

A OpenAI, empresa por trás do ChatGPT, lançou nesta quarta-feira, 7, o ChatGPT Health, uma nova ferramenta dedicada a conversas sobre saúde. A proposta é disponibilizar a inteligência artificial para responder dúvidas do dia a dia, assim como já era possível pelo GPT tradicional. Acontece que agora a ferramenta vai além. Usuários podem enviar registros médicos, solicitar insights a partir de exames de sangue, conectar aplicativos de saúde, como o Apple Health, receber orientações nutricionais e até pedir sugestões de refeições personalizadas durante o uso de canetas para obesidade e diabetes, como o Ozempic, Wegovy e Mounjaro.

O principal diferencial, segundo a gigante de tecnologia, está no desenvolvimento com a colaboração de mais de 260 médicos, o que amplia as capacidades do GPT tradicional quando o assunto é a saúde.

“São profissionais que ajudam a entender o que torna uma resposta sobre saúde útil ou potencialmente prejudicial. Esse grupo já forneceu feedback sobre as respostas do modelo mais de 600 mil vezes, em 30 áreas de foco”, destacou a OpenAI em comunicado.

Segundo a empresa, a saúde já está entre os usos mais frequentes do ChatGPT. Atualmente, mais de 230 milhões de pessoas no mundo fazem perguntas sobre saúde e bem-estar toda semana na plataforma. “Hoje, as informações de saúde costumam ficar espalhadas por portais, aplicativos, dispositivos vestíveis, PDFs e anotações médicas. Isso dificulta enxergar o panorama completo e faz com que as pessoas tenham que navegar sozinhas por um sistema de saúde complexo”, declarou a empresa.

Ela reforça, no entanto, que a ideia não é substituir o atendimento médico, mas ajudar o usuário a lidar com dúvidas cotidianas e a identificar padrões ao longo do tempo, e não apenas em momentos de doença, para chegar mais preparado a consultas e decisões importantes. “Ele não se destina a diagnóstico ou tratamento”, frisou.

Outro ponto do lançamento é a promessa de maior proteção dos dados. A OpenAI afirma que, diferentemente do ChatGPT tradicional, as conversas no ChatGPT Health não serão usadas para treinar os modelos de inteligência artificial da companhia.

Justamente por isso, a ferramenta funciona em um ambiente separado, com memórias próprias. Na prática, isso significa que as informações de saúde ficam isoladas, para que não “vazem” para outras conversas nem alimentem os modelos fundacionais da OpenAI. “Por causa da natureza sensível dos dados de saúde, o ChatGPT Health se baseia nessa fundação com proteções adicionais, incluindo criptografia e isolamento desenvolvidos especificamente para esse tipo de informação”, afirmou.

Fila de espera

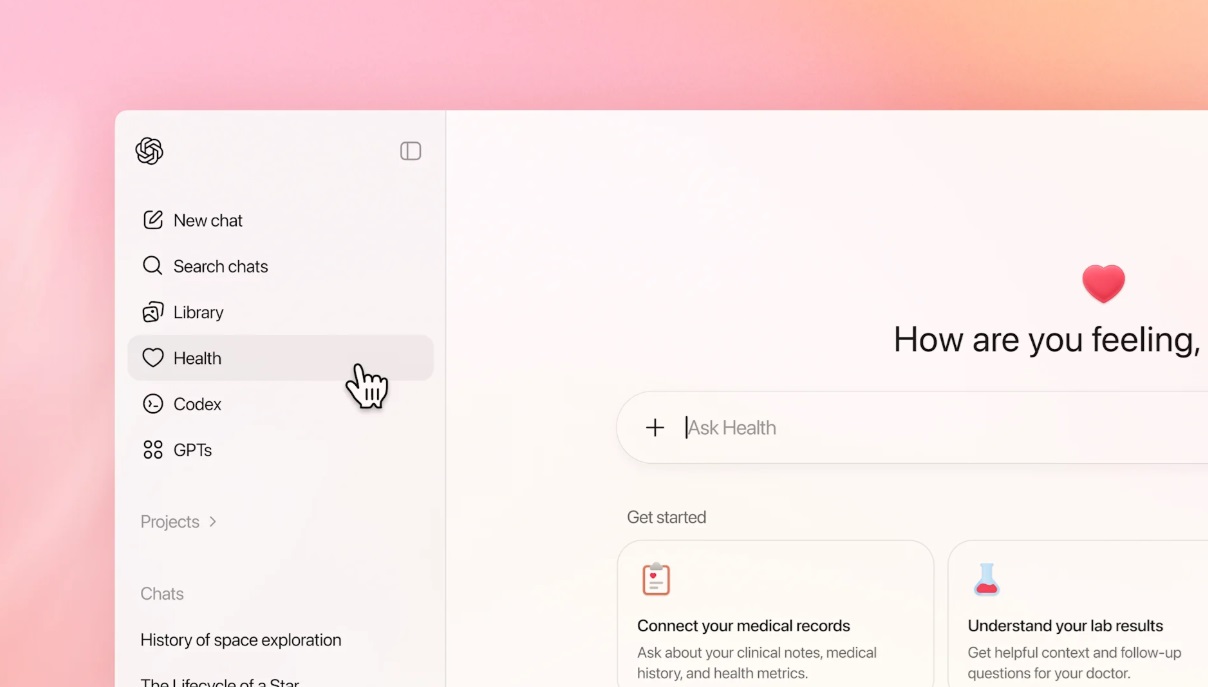

Em relação à estrutura da plataforma, a ferramenta não terá um site próprio. O acesso será feito dentro do próprio ChatGPT, por meio de um menu específico. “Ele estará em um espaço próprio dentro do ChatGPT, onde suas conversas, aplicativos conectados e arquivos ficam armazenados separadamente das suas outras conversas”, explicou a empresa.

Por enquanto, a ferramenta ainda não está disponível de forma ampla. Quem acessa o site da OpenAI encontra um convite para entrar em uma fila de espera. Segundo a empresa, um grupo limitado de usuários foi selecionado para testar a nova função.

“Estamos começando com um pequeno grupo de usuários para aprender e continuar refinando a experiência”, diz a OpenAI. “À medida que fizermos melhorias, planejamos ampliar o acesso e disponibilizar o ChatGPT Health para todos os usuários na web e no iOS nas próximas semanas.”

Cautela

Do ponto de vista do Conselho Federal de Medicina (CFM), o avanço da inteligência artificial na saúde exige cuidado. Para Jeancarlo Cavalcante, 3º vice-presidente do CFM e coordenador da Comissão de Inteligência Artificial na Medicina, há riscos tanto para pacientes quanto para médicos.

Vale lembrar que há diversos casos em que o uso de tecnologias de IA em temas sensíveis de saúde não teve bons desfechos, especialmente quando o assunto é terapia, uma das funções mais acessadas em ferramentas como o ChatGPT, segundo levantamento publicado na Harvard Business Review. Em abril do ano passado, o adolescente americano Adam Raine, de 16 anos, tirou a própria vida após trocar mensagens com a máquina.

Os pais do jovem, após analisarem os longos diálogos, decidiram processar a OpenAI, empresa comandada por Sam Altman, acusada de “morte por negligência”. No processo, ao qual VEJA teve acesso, o sistema é acusado de “cultivar uma relação que levou Adam a se afastar de seu suporte real de vida e a acreditar que havia construído um vínculo emocional verdadeiro com a IA”.

“Existe sempre o risco de o paciente, munido dessas informações, tomar decisões por conta própria, como a automedicação ou escolhas clínicas equivocadas, e deixar de procurar o médico para uma orientação mais segura”, avalia Cavalcante.

Entre os profissionais de saúde, ele também aponta o risco da automatização excessiva do atendimento. “O médico pode acabar focando apenas em informações específicas trazidas pela inteligência artificial e deixar de individualizar o tratamento, além de não explorar outros sinais ou sintomas que o paciente possa apresentar.”

Apesar das ressalvas, o representante do CFM reconhece possíveis benefícios. “O paciente tende a chegar à consulta mais informado, o que pode ser positivo. Por outro lado, isso exige que o médico explique eventuais divergências entre as informações obtidas pela IA e o quadro clínico real”, observa.

Para Cavalcante, a principal orientação é ter em mente que se trata de uma tecnologia de informação, e não de uma ferramenta para tomada de decisão. Ele cita, inclusive, alertas feitos pela própria OpenAI de que recursos como o ChatGPT Health devem servir para preparar o paciente para a consulta, ajudando a formular melhores perguntas, e não para substituir a visita ao profissional de saúde.

Já para os médicos, o recado passa pela ética e pelachecagem. “O profissional não pode abrir mão da transparência no atendimento nem deixar de confirmar se as informações geradas por inteligência artificial estão cientificamente alinhadas com o conhecimento atual.”

Segundo Cavalcante, o CFM trabalha há cerca de 18 meses na elaboração de uma resolução específica sobre o uso da inteligência artificial na medicina. A proposta deve ser votada ainda neste mês de janeiro e, se aprovada, será a primeira norma do conselho voltada exclusivamente ao tema.

Compartilhe essa matéria via: